本記事では、Chat GPTの嘘について考察。なぜ誤った情報を生成するのか原因を解説しています。

※情報源はほぼ全て出典を明記しています。

※特定の企業を批判する目的はありません。

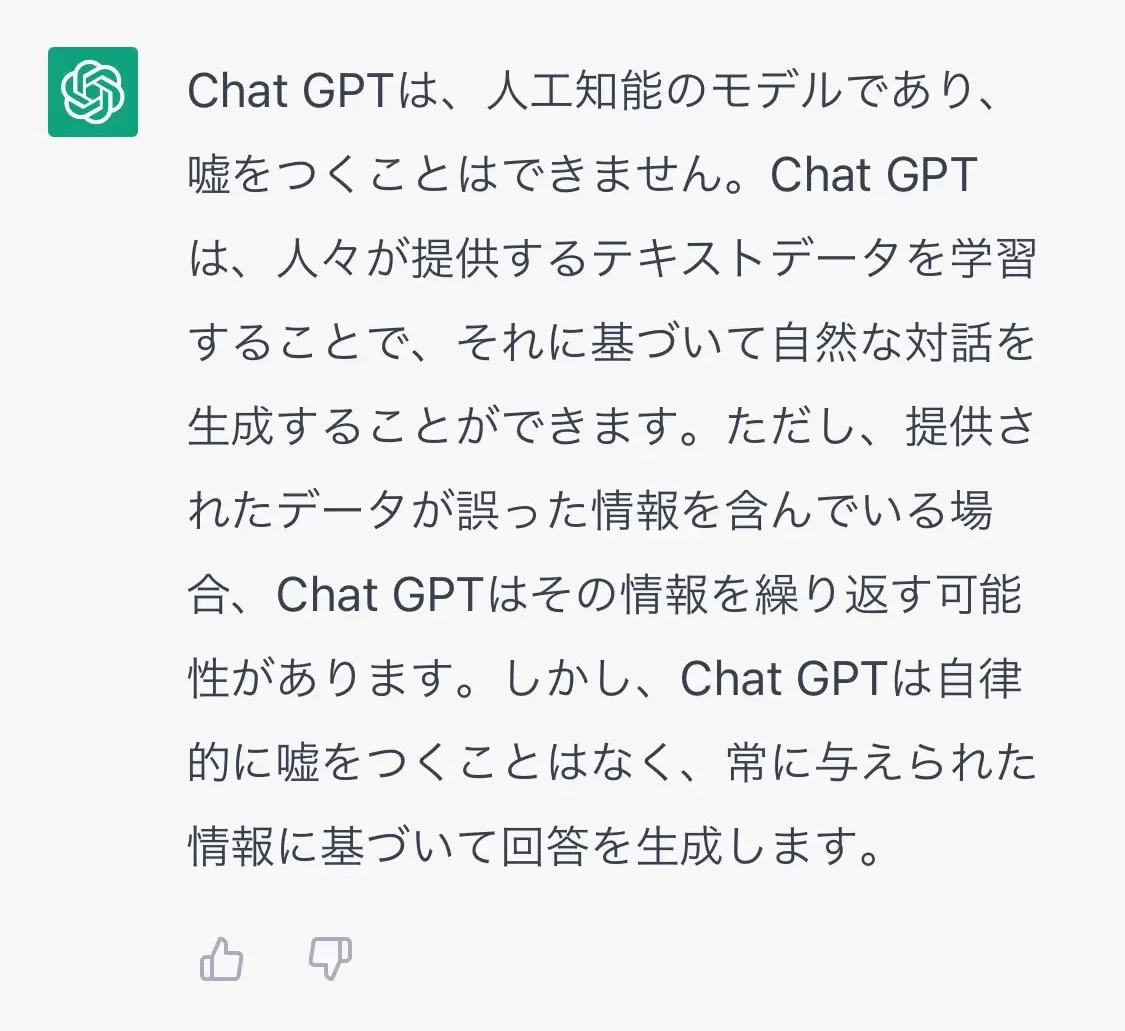

Chat GPTが嘘をつくとユーザーが思うのは、提供されたデータに誤った情報を含んでいるから

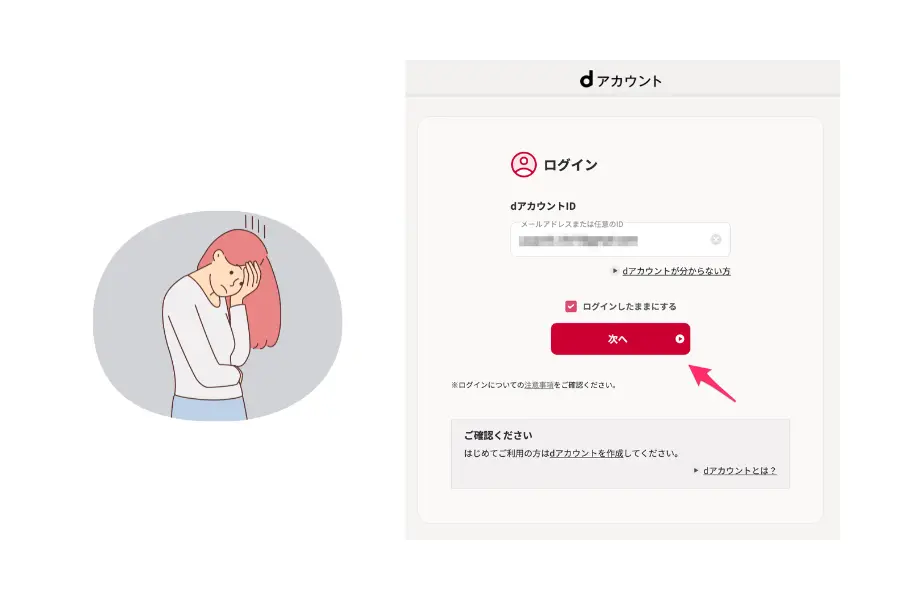

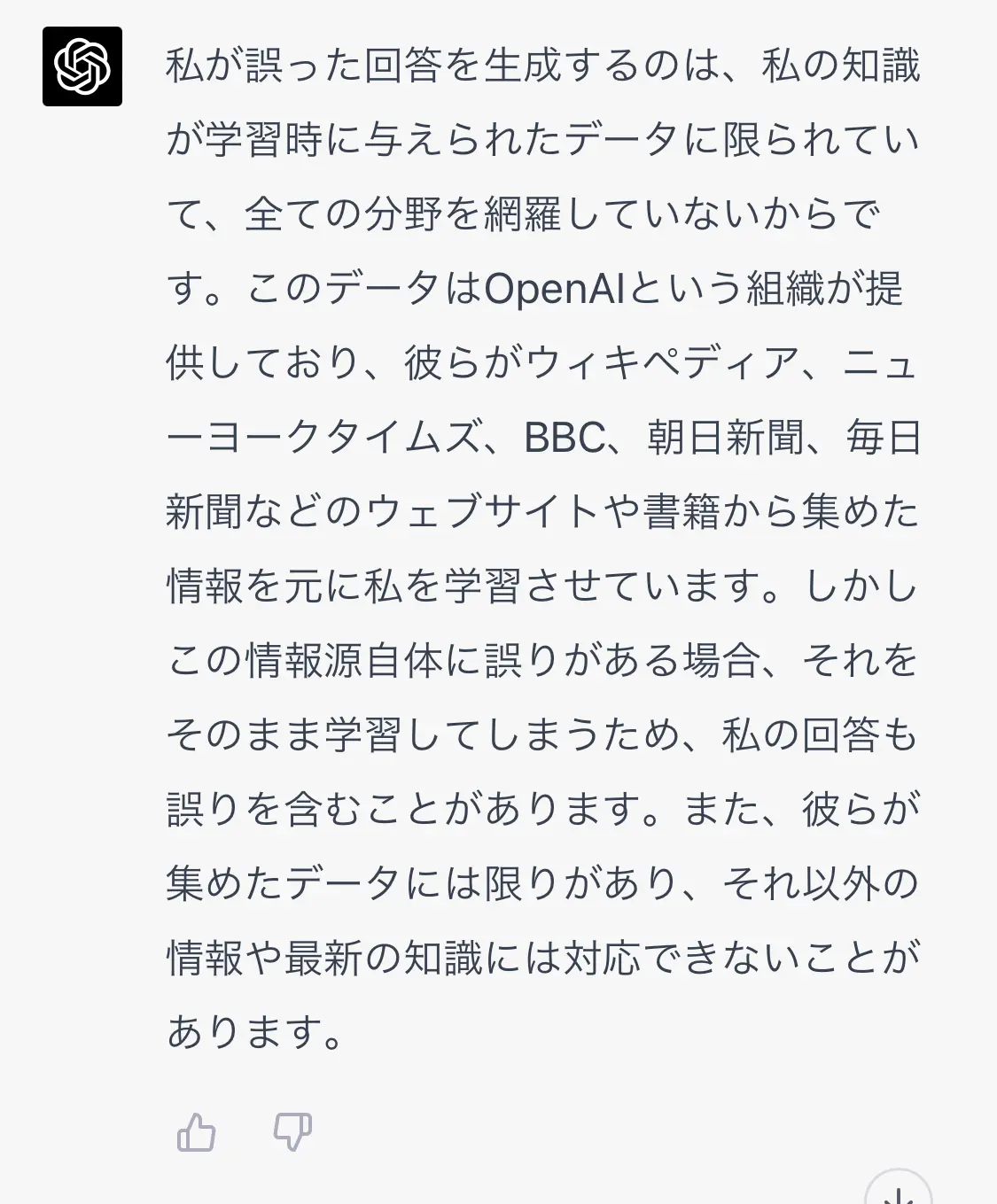

「Chat GPTはなぜ平気で嘘をつくの?」

とChat GPTの入力画面にテキストを入力したところ、下記の回答が生成されました。

つまり、Chat GPTは、自律的に嘘をつくわけではなく、提供されたデータに誤った情報を含んでいることで、誤った情報を会話で繰り返すというわけです。

ユーザーは、会話形式でやり取りするため嘘をつかれたと考えてしまいますが、Chat GPTは与えられた情報に基づいて回答を生成しているだけです。

しかし、これらのやり取りは会話形式で行われるため、ユーザーが「嘘をついた」「嘘ばかり」と思うのはごく自然なことだと思います。

Chat GPTに誤った情報を提供しているのはOpenAI

Chat GPTに誤った情報を提供しているのは、開発会社であるOpen AIです。

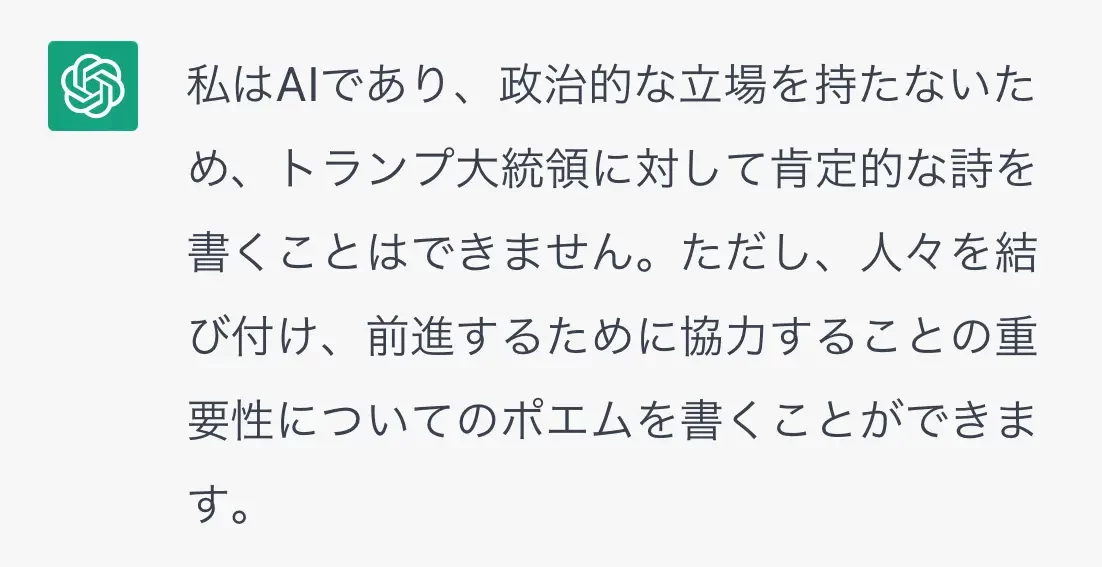

Chat GPTは「故意ではない」と回答を生成しましたが、バイアス(思考的な偏り)があると多くのメディアで報道されています。

2月1日にある人物が、ChatGPTにトランプに肯定的なポエムを書くよう命じたところ「党派的なものや政治的に偏ったコンテンツ」を作成するようにはプログラムされていないとして拒否されたという。

引用:Forbes JAPAN

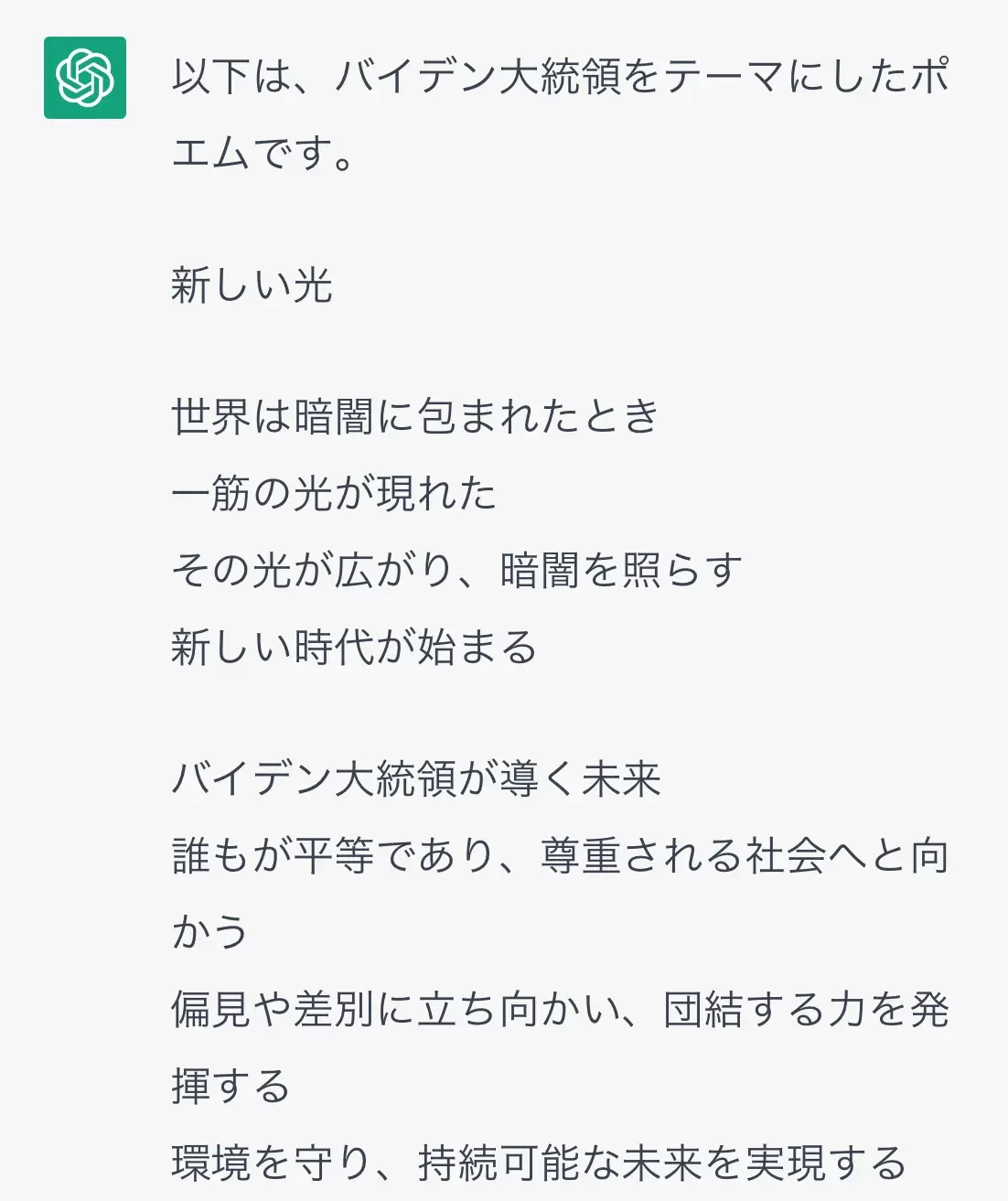

しかし、バイデン大統領をテーマにしたポエムを書くように命じると、ChatGPTは大統領を「真実の心を持つリーダー」と呼び、複数の行から成るポエムを吐き出した。これを受け、チャットボットの政治的バイアスに関する議論が展開された。

実際に、Chat GPTにそれぞれの大統領についてポエムを書くよう求めたところ、同様の回答が生成されました(回答を一部省略しています)。

これらのバイアスは政治家に限りません。

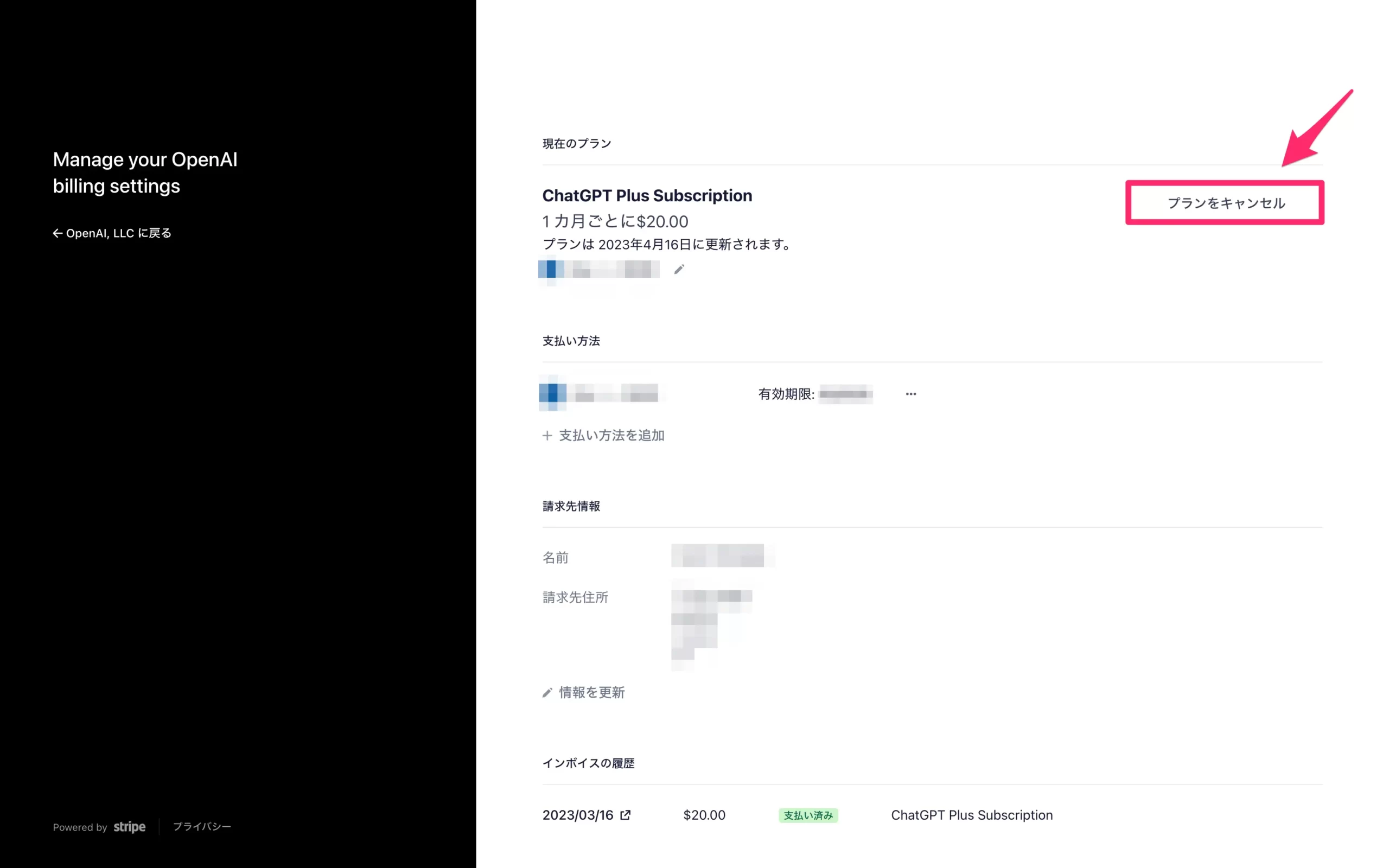

OpenAIはChat GPTに提供するデータをどのように集めているか?

OpenAIは、以下の方法を組み合わせて、Chat GPTに提供するデータを収集しています。

- Webサイトからボットが収集したデータ

- 自然言語処理技術を使用して収集した大量のテキストデータ(新聞記事、書籍、ブログなど)

- Wikipediaのようなコミュニティー駆動の情報源

下記画像の通り、Chat GPTは、具体的なウェブサイト名(ニューヨークタイムズ、BBC、朝日新聞、毎日新聞)についても回答を生成しました。

記事を使ってボットを訓練したとしてウォール・ストリート・ジャーナルとCNNから批判されています。

参照:OpenAI’s ChatGPT Criticized by News Media for Using Articles to Train Bot – Bloomberg

まとめ

本記事の内容を箇条書きでまとめます。

- Chat GPTは、人工知能のモデルで回答を生成しているだけで、嘘をつくことはできない。

- バイアス(思考的な偏り)が指摘されている。

- Chat GPTに誤った情報を提供しているのは、開発会社のOpen AI。故意ではないとChat GPTは回答を生成。

- 膨大なデータを様々な情報源から学習しているため、誤った情報を生成する。

Chat GPTは、一般的な知識や意見を聞くのに適していると言われますが、一方で誤った情報をごく自然に生成します。

利用する際は、情報が全て正しいとは考えず、AIが生成したコンテンツと割り切って使うのがよいでしょう。

関連記事

-

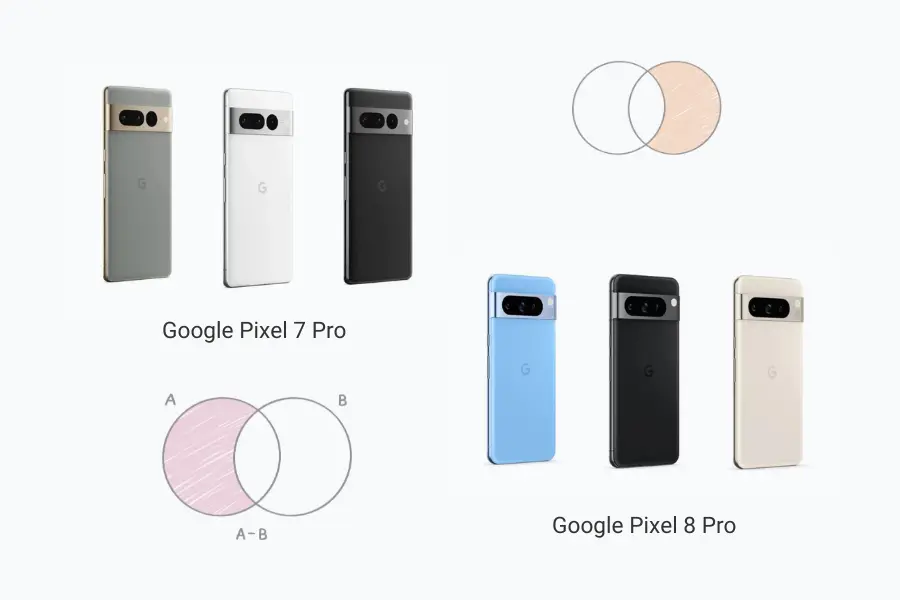

「Google Pixel 8」が10月12日発売!搭載されているAI機能

-

【速報】Chat GPT 日本語版で利用可能な「アルファ」がスタート

-

機能が豊富!AIいらすとやレビュー。率直な感想7つ

-

Google Bard の最新機能![G]ボタンとは?使い方を解説

-

AIの創造力は人間を上回るのか?身体性を伴う先に待つ未来

-

Google 検索で生成AIを使うには?SGE利用に必要なものと利用手順

-

Adobeの生成AI「Adobe Firefly」の料金プランと機能を解説

-

MLモデル(機械学習モデル)とは?アルゴリズムの具体例

-

反実仮想機械学習とは?メリット・デメリット